编者注

近年来,随着通用人工智能(Artificial General Intelligence,AGI)研发进程不断推进,围绕其发展速度、战略竞争与潜在风险的政策讨论在全球范围内持续升温。相较于既有人工智能技术,AGI在能力层级与潜在影响上被普遍视为一种“非连续性跃迁”,其可能带来的经济、军事与地缘政治后果,使其迅速成为大国竞争与全球治理议程中的关键议题。在这一背景下,如何理解国家在AGI竞赛中“加速发展”与“风险克制”之间的战略权衡,已成为当前人工智能治理讨论中的核心问题之一。兰德公司(RAND Corporation)长期关注新兴技术对国际安全与全球秩序的影响,其下属的通用人工智能地缘政治研究中心(Center for the Geopolitics of Artificial General Intelligence)于2025年发布的这篇研究报告,尝试以博弈论方法对AGI竞赛的激励结构进行形式化分析,为相关政策争论提供一个结构化的理解框架。

《A Prisoner’s Dilemma in the Race toAGI(2025)》

来源:兰德公司(RAND Corporation)

本文系对该报告的中文学术编译。译文仅呈现原文作者的分析逻辑与研究结论,不代表编译者或发布平台的立场。

有关模型推导与技术分析细节,请参阅 RAND官方原文。

摘要

本文编译自兰德公司(RAND Corporation)于 2025 年发布的一项研究报告。该报告旨在通过一个在数学上保持中立的博弈论模型,对当前围绕通用人工智能(Artificial General Intelligence,AGI)竞赛的核心政策争论进行形式化刻画,以帮助政策制定者比较国际技术竞争中不同战略选择可能产生的结果。分析假定,各国在AGI竞赛中的关键抉择在于是否加速研发,而这一选择取决于对“率先实现AGI所带来的先发优势收益”与“加速发展所伴随的潜在风险”之间的权衡。

报告指出,这些风险包括但不限于失控或未对齐AGI的出现、非专业行为体滥用相关技术以制造大规模杀伤性武器、大国间不稳定态势升级为冲突的可能性,以及其他对人类生存、繁荣与全球安全构成的系统性威胁。尽管该模型无法全面反映现实中AGI竞赛的复杂动态,但研究表明,在缺乏以对全球风险形成共同认知为基础的协调机制之前,各国面临的激励结构仍将持续指向加速发展路径。该分析为理解AGI竞赛的战略逻辑及其地缘政治含义提供了一个清晰的分析框架。

作者

丽莎·亚伯拉罕(Lisa Abraham),兰德公司经济学家、兰德公共政策学院政策分析教授;

约书亚·卡夫纳(Joshua Kavner),兰德公司研究员;

艾尔文·穆恩(Alvin Moon),兰德公司数学家

引言

近年来,美国及全球范围内的科技企业正加速推进通用人工智(Artificial General Intelligence,AGI)的研发进程。AGI通常被界定为一种能够在大多数,乃至几乎所有经济与军事相关任务中,替代或超越人类认知能力的人工智能形态。尽管学界与产业界对于AGI能否实现、何时实现以及通过何种技术路径实现仍存在广泛争议,但“率先实现AGI”本身,已成为多国政府与领先科技企业公开宣示的战略目标。

图源:世界经济论坛(WEF)

推动AGI竞赛的核心动力,在于其潜在的变革性影响。率先实现AGI的行为体,可能在技术标准与规则制定、新兴产业生态、地缘政治影响力以及军事能力等方面获得显著的“先发优势”(“first-mover”advantages),包括在技术标准与规则制定中的主导权、对新兴市场与产业生态的控制力、地缘政治与战略层面的杠杆效应,以及潜在的军事优势等。相关研究估计,人工智能技术可能带来高达每年17.1–25.6万亿美元的全球经济回报,这一预期进一步放大了国家与产业层面的竞争压力,使“加速发展”逐渐成为主导性的政策与产业叙事。

然而,与先发优势相伴而生的,是AGI研发所蕴含的深层次系统性风险。这些风险不仅包括军事化应用、关键基础设施破坏以及大规模杀伤性武器扩散等安全威胁,也体现在高度复杂的人工智能系统在与社会—技术系统交互过程中可能产生的不可预测后果。现实中的人工智能应用,已在算法歧视、隐私侵害、能源消耗等方面放大了既有治理挑战,而AGI的潜在影响规模显然更为深远。

正因如此,围绕AGI的国际讨论逐渐呈现出一种张力结构:一方面,各国与企业在竞争逻辑驱动下不断提速;另一方面,专家、国际组织与产业界行为体日益强调风险管控与治理协调的重要性。欧盟《人工智能法案》的出台、领先AI实验室发布的安全与对齐承诺,以及部分技术领袖关于“制度准备不足”的公开警告,均体现了这一张力。然而,这些立场并非简单对立,而是反映了一个更为复杂的激励问题:在高度竞争的环境中,理性行为体是否具备单方面放缓或协调的激励。

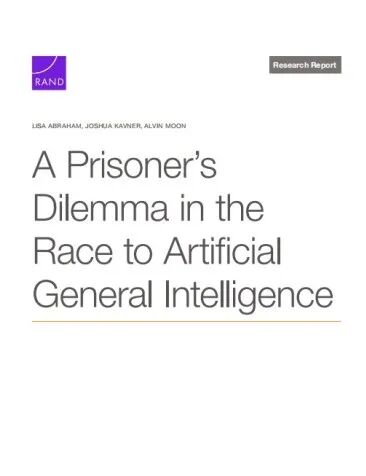

OECD人工智能框架

来源:世界经合组织(OECD)

现有研究表明,在类似安全困境的结构下,即便所有参与者都能从合作中获益,竞争仍可能将各方锁定在次优均衡之中。近年来,学界已将这一分析框架引入人工智能与AGI领域,探讨技术竞争、风险认知与制度安排如何共同塑造国家行为。然而,对于AGI竞赛的激励结构,尤其是在先发优势与系统性风险并存条件下,仍缺乏清晰、可比较的形式化分析工具。

在这一背景下,报告通过一个简化但数学上中立的博弈论模型,刻画了国家在是否加速AGI研发问题上的核心战略权衡。模型将复杂现实简化为一个关键问题:在国际竞争中,率先实现AGI的收益是否超过加速AGI研发所带来的风险与潜在成本。通过比较不同激励条件下的均衡结果,分析国家行为的内在动因,并探讨在高度竞争情境下引导竞赛走向“全球更优结果”(globally desirable outcomes)的可能制度路径,识别国际协调与合作何以可能、又在何种条件下面临约束,从而为政策制定者理解AGI竞赛的结构性逻辑提供分析框架。

博弈论模型

报告将AGI竞赛形式化为一个高度简化的博弈论模型,目的并非刻画现实中所有可能的战略互动,而是突出在存在重大系统性风险的前提下,各国在是否加速AGI研发问题上所面临的基本激励结构。模型关注的核心问题是:在预期收益与风险并存的情况下,国家理性行为是否必然导向加速竞争?

在模型设定中,假定存在两个能力与信息对称的国家行为体为参与者,每一方在同一时间点作出决策,选择是否采取“加速策略”(Accelerated strategy)即在研发过程中相对弱化对安全性、稳健性与风险缓解的优先考量,从而提高率先实现AGI的概率的策略。相对地,不加速则意味着维持更为谨慎的发展路径,即“基础策略”(Baseline strategy)。

模型进一步假定,无论各方采取何种策略组合,AGI最终都会被某一方率先实现。若某一国家率先实现AGI,则其将获得额外的先发优势收益;而未率先实现的一方,仍可能在后续阶段通过技术扩散获得一定收益。与此同时,报告明确指出,只要至少有一方选择加速研发,系统性风险便会被引入,并可能对所有行为体造成负面影响,并且这些风险并不局限于单一国家,而是有可能外溢乃至扩展到全球。

在上述假定下,报告分析了不同策略组合下的预期收益结构。其核心结论是:当率先实现AGI所带来的预期收益显著高于加速研发所引入的风险成本时,“加速策略”对单个国家而言构成理性的选择。即便各方均认识到共同加速可能导致更高的整体风险,在缺乏协调机制的情况下,理性决策仍可能将博弈推向双方同时加速的结果。这一情形在博弈论意义上对应于囚徒困境。

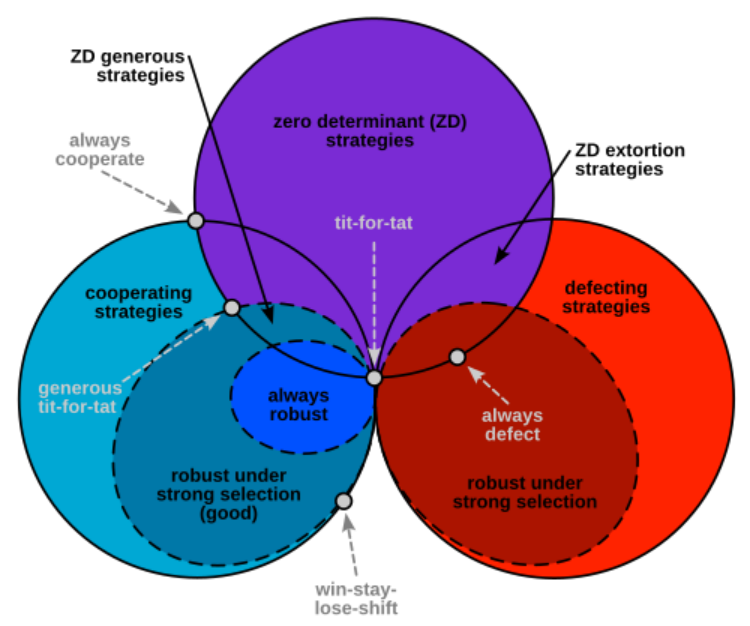

囚徒困境结构示例图

来源:维基百科(Wikipedia)

相反,当加速研发所引入的系统性风险被认为高于先发优势所能带来的额外收益时,博弈结构将发生变化。在这种情况下,各方更有动力维持谨慎的发展路径,即选择“基础策略”,而“加速策略”这时不再成为占优策略。报告指出,此时博弈更接近一种协调问题:若各方能够形成对风险的共同认知并预期他方不会单方面加速,则集体维持较慢发展节奏将带来更高的总体收益。

通过这一模型,报告并未断言现实中的AGI竞赛必然符合某一特定博弈类型,而是强调:竞赛的结构性结果取决于各方如何评估先发优势与风险成本之间的相对大小,以及是否存在改变激励结构的制度性安排。

AGI的时间性竞赛

报告指出,将AGI竞赛理解为一次性博弈在分析上具有重要启发意义,但现实中的AGI研发更符合一种渐进式、持续的竞争过程:国家与企业并非只在单一节点作出决策,而是在不确定的时间跨度内持续投入资源,并据此持续根据对手行为与技术进展调整自身策略。

在这一背景下,报告将AGI竞赛视为一种“具有随机终止时间的重复博弈”。在每一个阶段,行为体都面临是否加速研发的选择,而竞赛在某一未知时间点会因为某国AGI的实现而终止。该设定允许分析随着时间推移,行为体如何在短期收益、长期风险与未来预期之间进行权衡。

报告强调,在时间性竞赛中,阶段性收益与长期结果之间的关系尤为关键。如果行为体从持续参与竞赛中获得的累积收益较高,且对系统性风险的评估在各阶段保持稳定,则即便存在强烈竞争动机,各方仍可能在一定条件下维持较为谨慎的发展路径。

图源:印度分析杂志(AIM)

此外,报告指出,时间结构为合作或克制提供了潜在空间。通过重复互动,行为体可以基于历史行为形成预期,并在一定程度上运用声誉、惩罚或条件性策略来约束对方的行为。然而,这种结果高度依赖于行为体对风险的共同认知以及对未来互动持续性的预期,一旦各方认为竞赛即将进入终局阶段,或担心对手在最后阶段突然加速,维持克制的激励将显著削弱。

因此,报告认为,将AGI竞赛置于时间维度中考察,并不会自动消解囚徒困境式的结构性风险,但有助于解释为何在某些条件下,行为体可能暂时避免最具风险的加速路径。最终是否能够实现较为稳定的合作结果,仍取决于制度安排是否能够影响各方对未来收益与风险的预期。

战略启示与政策建议

分析表明,围绕通用人工智能(AGI)的国家间战略互动,根本上取决于各国对先发优势收益与系统性风险成本的相对评估,以及是否存在能够将这种评估转化为可预期、可验证行为的协调机制。在缺乏有效制度安排的情况下,即便各方均意识到无序竞赛可能带来灾难性后果,理性决策仍可能将竞争锁定在以加速发展为特征的高风险均衡之中,这一结构性结果在博弈论意义上表现为囚徒困境。

在中美人工智能竞争的具体语境下,若双方普遍认为率先实现AGI所带来的经济、战略与地缘政治收益显著高于潜在风险,则对对手“抢先突破”的担忧将持续强化各自的加速动机,从而削弱单方面克制的可行性。相反,只有当双方逐步形成对失控或未对齐AGI所引发系统性风险的共同认知,并将这种认知嵌入可验证的制度安排之中,战略互动才可能从囚徒困境转向更具合作性的协调博弈。历史经验表明,在涉及存在性或高度系统性风险的领域,竞争对手并非必然陷入无限升级,而是可能通过制度化安排实现集体克制与风险缓解。

“AI for Good”2025峰会

来源:国际电信联盟(ITU)

从更一般的政策含义看,研究揭示,AGI治理中的核心问题并非“发展”与“安全”之间的简单取舍,而是激励结构如何塑造国家行为。若各国在战略评估中系统性高估先发优势收益、低估加速竞争带来的长期风险,则竞赛将持续沿着高风险路径推进。相应地,改变这一轨迹的关键不在于诉诸高度信任或价值趋同,而在于通过风险评估合作、最低限度的信息共享与透明机制,以及制度化的相互约束工具,重塑各国对风险—收益结构的预期判断。

因此,研究并不主张简单地放缓或暂停AGI研发,而是强调:只有当治理机制能够在结构上改变国家面临的战略激励,使克制与合作在理性计算中成为可持续选项,国际社会才有可能在推动技术进步的同时,降低由无序竞赛所带来的系统性风险。

局限性与未来研究方向

与所有博弈论分析类似,研究通过高度简化的设定来突出通用人工智能(AGI)竞赛中的核心激励结构。这一处理方式有助于澄清先发优势与系统性风险之间的基本权衡,但也意味着模型在若干关键维度上有意抽象了现实复杂性。以下从结构性假设的角度,对模型的主要局限性及潜在扩展方向加以说明。

第一,优势结构的设定具有简化性。研究以“先发优势”为核心收益变量,未系统展开后发行为体可能从技术扩散、学习效应或制度模仿中获得的潜在收益。若后发优势在现实中显著存在,甚至超过先发优势,博弈的收益排序与战略选择将随之发生变化。这一情形在既有博弈论与产业组织研究中具有理论与经验支持。

第二,研发速度、风险与收益之间的关系被假定为稳定。模型假定加速研发既提高率先实现AGI的概率,又通过风险外溢机制引入共享的灾难性成本。然而,在现实中,研发速度与风险、收益之间的关系可能更加复杂。例如,加速发展可能因事故或治理失败引发公众反弹,从而削弱先发优势;反之,风险也未必始终与速度正相关。若这些关系发生变化,国家的最优战略选择亦将相应调整。

第三,国家间的对称性假设限制了模型的适用范围。研究假定各国在收益、成本与风险承受能力上大体对称,但现实中的国家在经济结构、技术基础与制度环境方面存在显著差异。这些差异可能导致同一战略选择在不同国家产生不对称的收益与风险,从而改变博弈均衡。

第四,成本与收益被视为外生且相互独立。模型将灾难性风险成本与先发或后发优势收益视为相互独立的变量。然而,在现实情境中,更高的潜在收益可能伴随着更高(或更低)的风险暴露。如果成本与收益之间存在系统性关联,国家在策略权衡上的逻辑将随之改变。

第五,行为体与信息结构的简化。研究分析聚焦于两个国家在完全信息、同时行动条件下的战略互动,而现实中的AGI竞赛涉及多国政府、私营企业等多重行为体,并可能伴随不完全信息、非同时决策以及对风险与收益的不同认知。将模型扩展至多行为体、不完全信息或序贯博弈框架,有助于更全面地刻画国际竞争与合作的动态过程。

总体而言,这些局限性并不削弱本文模型的分析价值,而是界定了其解释力的适用范围。未来研究可在放宽上述假设的基础上,对AGI竞赛的战略逻辑进行更精细的刻画。

结论

通用人工智能的全球竞赛体现了技术进步逻辑与国际安全逻辑的深度交织。通过构建一个数学上中立的博弈论模型,本文系统揭示了先发优势、风险认知与制度安排如何共同塑造国家在AGI竞赛中的战略选择。研究表明,若不对激励结构加以调整,AGI竞赛可能被锁定在高风险路径之中;而通过增强国际协调、提升风险透明度与构建可信治理机制,国际社会仍有可能在保持技术创新的同时,降低系统性风险,并推动AGI朝着更安全、可持续的方向发展。